Um feito que abalou o mercado da publicidade como há tempos não acontecia trouxe à tona o poder (assustador!) do uso da Inteligência Artificial (IA). Na propaganda criada pela agência AlmapBBDO, apresentada pela Volkswagen para celebrar os 70 anos de presença da marca no Brasil, a cantora Elis Regina, que morreu em 1982, “divide” a cena e os vocais da icônica canção “Como Nossos Pais” com sua filha, Maria Rita. Mas o chamado deepfake também já chegou nas cidades.

As “deepfake geográficas”, ou deepfake nas cidades, são ilustrações manipuladas e irreais de imagens de satélite. Normalmente, as fotos reais de GPS e de satélite são geradas por profissionais em geografia ou governos, o que dá um grau de autenticidade e veracidade para o público.

Com o poder de recriar e remontar imagens de satélite, a técnica de inteligência artificial generativa pode gerar ainda mais desconfianças com os sistemas oficiais. Dois exemplos já aconteceram: uma suposta imagem da Índia vista via satélite durante o festival Diwali se espalhou pela internet. Mas a foto era falsa.

Outra ilustração falsa foi a de um incêndio no Central Park, em Nova Iorque, visto de cima. Pesquisadores da Universidade de Washington, nos Estados Unidos, resolveram usar a IA para provar que nem mesmo os satélites estão imunes às fake news.

Veja também o episódio 38 do podcast Habitability: Inteligência Artificial: impactos na habitação

Deepfake geográfica não é photoshop

“Isso não é apenas Photoshop. Está fazendo com que os dados pareçam incrivelmente realistas”, disse Bo Zhao, professor assistente de geografia na Universidade de Washington e principal autor do estudo, publicado na revista Cartography and Geographic Information Science. “As técnicas já estão aí. Estamos apenas tentando expor a possibilidade de usar as mesmas técnicas e a necessidade de desenvolver uma estratégia de enfrentamento para isso.”

A técnica em questão é a da “deepfake”, uma técnica de síntese de imagens ou sons baseados em técnicas de inteligência artificial generativa. Assim como o ChatGPT faz com os textos, os sistemas de deepfake conseguem “recriar” imagens – e vídeos de pessoas – a partir dos dados já existentes.

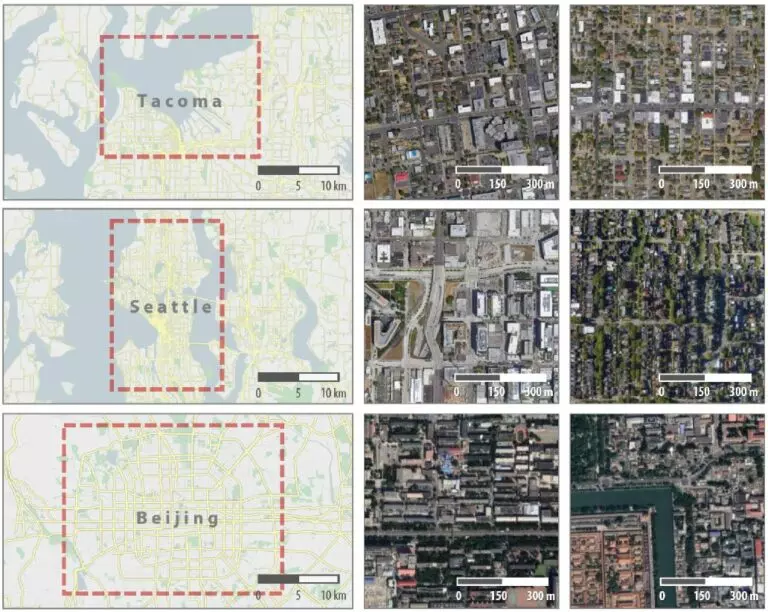

Os pesquisadores da Universidade de Washington combinaram mapas e imagens de satélite de três cidades, Tacoma e Seattle, localizadas no norte dos Estados Unidos, e Pequim, na China. O software criado analisou as fotografias e entendeu quais os padrões de uma foto deste tipo.

Tacoma-Fake

Para estudar como as imagens de satélite podem ser falsificadas, Zhao e sua equipe recorreram a uma estrutura de IA usada na manipulação de outros tipos de arquivos digitais. Quando aplicado ao campo de mapeamento, o algoritmo aprende essencialmente as características das imagens de satélite de uma área urbana e, em seguida, gera uma imagem deepfake, alimentando as características das imagens de satélite aprendidas em um mapa base diferente – semelhante a como os filtros das redes sociais são usados. Eles mapeiam o rosto de quem tira a selfie e alteram a imagem gerada ao vivo.

O resultado foi um mapa do bairro de Tacoma com padrões visuais parecidos com os de Seatlle e Pequim, como os edifícios altos e as redes rodoviárias dos espaços.

Deepfake nas cidades: tome cuidado com a desinformação!

Em entrevista ao The Verge, Zhao explicou que um olho destreinado pode ter dificuldades em detectar diferenças entre imagens reais e falsas de satélite. O objetivo, disse Zhao, “é desmistificar a função de confiabilidade absoluta das imagens de satélite e aumentar a conscientização pública sobre a influência potencial da geografia falsa profunda”. Ele diz que, embora os deepfakes sejam amplamente discutidos em outros campos, seu artigo é provavelmente o primeiro a abordar o assunto na geografia.

O Verge também entrevistou Todd Myers, analista da National Geospatial-Intelligente Agency, a agência norte-americana de pesquisa geográfica. O especialista imaginou cenários onde as imagens seriam usadas para desinformar os softwares de segurança do país. “De uma perspectiva tática ou de planejamento de missão, você treina suas forças para seguir uma determinada rota, em direção a uma ponte, mas não está lá. Então, há uma grande surpresa esperando por você”, disse Myers.

Paper Towns e IA

Zhao, em fala para o site da Universidade de Washington, explica que o ato de mudar a cartografia para questões estratégicas já existe há muito mais tempo do que a tecnologia permite. As chamadas “paper towns” são assentamentos que aparecem no mapa, mas, de fato, não existem. Estes tipos de pontos são usados por cartógrafos para determinar a veracidade de seus mapas e também para evitar o plágio. O cartógrafo pode criar um local e, se vir que um cartógrafo concorrente também possui esse local em seu mapa, saberá que em determinado momento o concorrente plagiou seus dados.

Mas com a prevalência de sistemas de informações geográficas, Google Earth e outros sistemas de imagens de satélite, a falsificação de localização envolve muito mais sofisticação, dizem os pesquisadores, e traz consigo mais riscos. Em 2019, o diretor da Agência Nacional de Inteligência Geoespacial, organização encarregada de fornecer mapas e analisar imagens de satélite para o Departamento de Defesa dos EUA, deu a entender que as imagens de satélite manipuladas por IA podem ser uma grave ameaça à segurança nacional.

Para Zhao, porém, o mais importante é a conscientização para que os geógrafos não sejam pegos desprevenidos pelos deepfakes nas cidades. Como ele e seus colegas escrevem: “se continuarmos despreparados para deep fake, corremos o risco de entrar em uma distopia da ‘falsa geografia'”.